कर्नेल विधि

| Part of a series on |

| Machine learning and data mining |

|---|

|

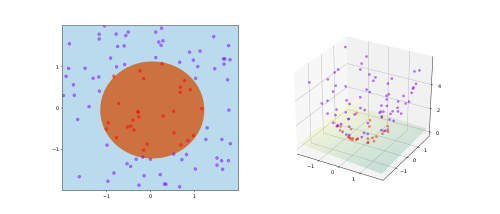

यंत्र अधिगम में, कर्नेल मशीन पैटर्न विश्लेषण के लिए एल्गोरिदम का एक वर्ग है, जिसका सबसे अच्छा ज्ञात सदस्य समर्थन वेक्टर यंत्र (एसवीएम) है। पैटर्न विश्लेषण का सामान्य कार्य डेटासेट में सामान्य प्रकार के संबंधों (उदाहरण के लिए क्लस्टर विश्लेषण, रैंकिंग, प्रमुख घटक, सहसंबंध, सांख्यिकीय वर्गीकरण) को खोजना और अध्ययन करना है। इन कार्यों को हल करने वाले कई एल्गोरिदम के लिए, कच्चे प्रतिनिधित्व में डेटा को उपयोगकर्ता द्वारा निर्दिष्ट फीचर मैप के माध्यम से फीचर वेक्टर प्रस्तुतियों में स्पष्ट रूप से परिवर्तित किया जाना चाहिए: इसके विपरीत, कर्नेल विधियों के लिए केवल उपयोगकर्ता-निर्दिष्ट कर्नेल की आवश्यकता होती है। , यानी, आंतरिक उत्पादों का उपयोग करके गणना किए गए डेटा बिंदुओं के सभी जोड़े पर एक समानता फ़ंक्शन। कर्नेल मशीनों में फीचर मैप अनंत आयामी है, लेकिन केवल प्रतिनिधि प्रमेय के अनुसार उपयोगकर्ता-इनपुट से एक परिमित आयामी मैट्रिक्स की आवश्यकता होती है। समानांतर प्रसंस्करण के बिना दो हजार उदाहरणों से बड़े डेटासेट के लिए कर्नेल मशीन की गणना धीमी है।

कर्नेल विधियों का नाम सकारात्मक-निश्चित कर्नेल के उपयोग के लिए दिया गया है, जो उन्हें उस स्थान में डेटा के निर्देशांक की गणना किए बिना एक उच्च-आयामी, अंतर्निहित सुविधा स्थान में संचालित करने में सक्षम बनाता है, बल्कि केवल गणना करके फीचर स्पेस में डेटा के सभी जोड़े की छवि (गणित) के बीच आंतरिक उत्पाद। यह ऑपरेशन अक्सर निर्देशांक की स्पष्ट गणना से कम्प्यूटेशनल रूप से सस्ता होता है। इस दृष्टिकोण को कर्नेल ट्रिक कहा जाता है।[1] अनुक्रम डेटा, ग्राफ कर्नेल, टेक्स्ट, इमेज, साथ ही वैक्टर के लिए कर्नेल फ़ंक्शंस पेश किए गए हैं।

गुठली के साथ काम करने में सक्षम एल्गोरिदम में कर्नेल परसेप्ट्रॉन, सपोर्ट-वेक्टर मशीन (एसवीएम), गाऊसी प्रक्रिया, प्रमुख घटक विश्लेषण (पीसीए), विहित सहसंबंध विश्लेषण, रिज प्रतिगमन , वर्णक्रमीय क्लस्टरिंग , अनुकूली फिल्टर और कई अन्य शामिल हैं।

अधिकांश कर्नेल एल्गोरिदम उत्तल अनुकूलन या ईजेनवेल्यू, ईजेनवेक्टर और ईजेनस्पेस पर आधारित हैं और सांख्यिकीय रूप से अच्छी तरह से स्थापित हैं। आमतौर पर, उनके सांख्यिकीय गुणों का विश्लेषण सांख्यिकीय शिक्षण सिद्धांत (उदाहरण के लिए, रेडेमाकर जटिलता का उपयोग करके) का उपयोग करके किया जाता है।

प्रेरणा और अनौपचारिक व्याख्या

कर्नेल विधियों को उदाहरण-आधारित शिक्षा के रूप में माना जा सकता है। उदाहरण-आधारित शिक्षार्थी: अपने इनपुट की विशेषताओं के अनुरूप मापदंडों के कुछ निश्चित सेट को सीखने के बजाय, वे याद रखते हैं -वें प्रशिक्षण उदाहरण और उसके अनुरूप वजन सीखो . बिना लेबल वाले इनपुट के लिए भविष्यवाणी, यानी, जो प्रशिक्षण सेट में नहीं हैं, एक समानता फ़ंक्शन के अनुप्रयोग द्वारा व्यवहार किया जाता है , जिसे कर्नेल कहा जाता है, बिना लेबल वाले इनपुट के बीच और प्रत्येक प्रशिक्षण इनपुट . उदाहरण के लिए, एक कर्नेलाइज़्ड बाइनरी क्लासिफायरियर आमतौर पर समानताओं के भारित योग की गणना करता है

- ,

कहाँ

- बिना लेबल वाले इनपुट के लिए कर्नेलाइज़्ड बाइनरी क्लासिफायर का अनुमानित लेबल है जिसका छिपा हुआ सच्चा लेबल रुचि का है;

- कर्नेल फ़ंक्शन है जो किसी भी जोड़ी इनपुट के बीच समानता को मापता है ;

- योग सीमा से अधिक है n लेबल किए गए उदाहरण वर्गीकारक के प्रशिक्षण सेट में, के साथ ;

- द प्रशिक्षण के उदाहरणों के लिए वज़न हैं, जैसा कि लर्निंग एल्गोरिथम द्वारा निर्धारित किया गया है;

- साइन समारोह निर्धारित करता है कि अनुमानित वर्गीकरण सकारात्मक या नकारात्मक निकलता है।

कर्नेल क्लासिफायर को 1960 के दशक की शुरुआत में कर्नेल परसेप्ट्रॉन के आविष्कार के साथ वर्णित किया गया था।[2] 1990 के दशक में सपोर्ट-वेक्टर मशीन (एसवीएम) की लोकप्रियता के साथ वे बहुत प्रमुखता से बढ़े, जब एसवीएम को लिखावट की पहचान जैसे कार्यों में कृत्रिम तंत्रिका नेटवर्क के साथ प्रतिस्पर्धी पाया गया।

गणित: कर्नेल ट्रिक

कर्नेल ट्रिक स्पष्ट मैपिंग से बचती है जो एक गैर-रैखिक फ़ंक्शन या निर्णय सीमा सीखने के लिए रैखिक सीखने के एल्गोरिदम प्राप्त करने के लिए आवश्यक है। सभी के लिए और इनपुट स्पेस में , कुछ कार्य एक अन्य स्थान में एक आंतरिक उत्पाद के रूप में व्यक्त किया जा सकता है . कार्यक्रम अक्सर कर्नेल या कर्नेल समारोह के रूप में संदर्भित किया जाता है। कर्नेल शब्द का उपयोग गणित में भारित योग या अभिन्न के लिए भारित फ़ंक्शन को निरूपित करने के लिए किया जाता है।

मशीन लर्निंग की कुछ समस्याओं में मनमाना भार फ़ंक्शन की तुलना में अधिक संरचना होती है . यदि कर्नेल को फ़ीचर मैप के रूप में लिखा जा सकता है, तो गणना करना बहुत आसान हो जाता है जो संतुष्ट करता है

मुख्य प्रतिबंध वह है एक उचित आंतरिक उत्पाद होना चाहिए। दूसरी ओर, के लिए एक स्पष्ट प्रतिनिधित्व जब तक आवश्यक नहीं है एक आंतरिक उत्पाद स्थान है। विकल्प मर्सर के प्रमेय से आता है: एक निहित रूप से परिभाषित कार्य अंतरिक्ष जब भी मौजूद होता है समारोह सुनिश्चित करने के लिए एक उपयुक्त उपाय (गणित) से लैस किया जा सकता है मर्सर की स्थिति को संतुष्ट करता है।

मर्सर का प्रमेय रैखिक बीजगणित से परिणाम के सामान्यीकरण के समान है जो सकारात्मक-निश्चित मैट्रिक्स#अन्य_चरित्रीकरण|किसी भी सकारात्मक-निश्चित मैट्रिक्स के लिए एक आंतरिक उत्पाद को जोड़ता है। वास्तव में, मर्सर की स्थिति को इस सरल मामले में कम किया जा सकता है। यदि हम अपने माप के रूप में गिनती के उपाय को चुनते हैं सभी के लिए , जो सेट के अंदर अंकों की संख्या की गणना करता है , तो मर्सर के प्रमेय में अभिन्न एक योग में कम हो जाता है

यदि यह योग बिंदुओं के सभी परिमित अनुक्रमों के लिए है में और सभी विकल्प वास्तविक मूल्यवान गुणांक (सीएफ सकारात्मक निश्चित कर्नेल), फिर कार्य मर्सर की स्थिति को संतुष्ट करता है।

कुछ एल्गोरिदम जो मूल स्थान में मनमाने संबंधों पर निर्भर करते हैं वास्तव में, एक अलग सेटिंग में एक रैखिक व्याख्या होगी: की रेंज स्पेस . रैखिक व्याख्या हमें एल्गोरिथम के बारे में जानकारी देती है। इसके अलावा, अक्सर गणना करने की कोई आवश्यकता नहीं होती है सीधे संगणना के दौरान, जैसा कि सपोर्ट-वेक्टर मशीनों के मामले में होता है। कुछ लोग इस रनिंग टाइम शॉर्टकट को प्राथमिक लाभ के रूप में उद्धृत करते हैं। शोधकर्ता इसका उपयोग मौजूदा एल्गोरिदम के अर्थ और गुणों को सही ठहराने के लिए भी करते हैं।

सैद्धांतिक रूप से, एक ग्राम मैट्रिक्स इसके संबंध में (कभी-कभी कर्नेल मैट्रिक्स भी कहा जाता है[3]), कहाँ , सकारात्मक-निश्चित मैट्रिक्स होना चाहिए | सकारात्मक अर्ध-निश्चित (PSD)।[4] अनुभवजन्य रूप से, मशीन लर्निंग ह्यूरिस्टिक्स के लिए, एक फ़ंक्शन के विकल्प जो मर्सर की स्थिति को संतुष्ट नहीं करते हैं, वे अभी भी यथोचित प्रदर्शन कर सकते हैं यदि कम से कम समानता के सहज विचार का अनुमान लगाता है।[5] दोनों में से किसी की परवाह किये बिना एक मर्सर कर्नेल है, अभी भी कर्नेल के रूप में संदर्भित किया जा सकता है।

यदि कर्नेल कार्य करता है गौसियन प्रक्रियाओं में उपयोग किए जाने वाले ग्राम मैट्रिक्स के रूप में भी एक सहप्रसरण कार्य है सहप्रसरण मैट्रिक्स भी कहा जा सकता है।[6]

अनुप्रयोग

कर्नेल विधियों के अनुप्रयोग क्षेत्र विविध हैं और इसमें भू-सांख्यिकी शामिल हैं,[7] सिंचाई, व्युत्क्रम दूरी भार, 3डी पुनर्निर्माण, जैव सूचना विज्ञान, रसायन सूचना विज्ञान, सूचना निष्कर्षण और हस्तलिपि पहचान।

लोकप्रिय गुठली

- फिशर कर्नेल

- ग्राफ गुठली

- कर्नेल चिकना

- बहुपद कर्नेल

- रेडियल आधार फ़ंक्शन कर्नेल (RBF)

- स्ट्रिंग गुठली

- तंत्रिका स्पर्शरेखा कर्नेल

- तंत्रिका नेटवर्क गाऊसी प्रक्रिया (NNGP) कर्नेल

यह भी देखें

- वेक्टर आउटपुट के लिए कर्नेल विधियाँ

- कर्नेल घनत्व अनुमान

- प्रतिनिधि प्रमेय

- समानता सीखना

- कवर का प्रमेय

संदर्भ

- ↑ Theodoridis, Sergios (2008). पैटर्न मान्यता. Elsevier B.V. p. 203. ISBN 9780080949123.

- ↑ Aizerman, M. A.; Braverman, Emmanuel M.; Rozonoer, L. I. (1964). "पैटर्न मान्यता सीखने में संभावित कार्य पद्धति की सैद्धांतिक नींव". Automation and Remote Control. 25: 821–837. Cited in Guyon, Isabelle; Boser, B.; Vapnik, Vladimir (1993). Automatic capacity tuning of very large VC-dimension classifiers. Advances in neural information processing systems. CiteSeerX 10.1.1.17.7215.

- ↑ Hofmann, Thomas; Scholkopf, Bernhard; Smola, Alexander J. (2008). "मशीन लर्निंग में कर्नेल तरीके". The Annals of Statistics. 36 (3). doi:10.1214/009053607000000677. S2CID 88516979.

- ↑ Mohri, Mehryar; Rostamizadeh, Afshin; Talwalkar, Ameet (2012). Foundations of Machine Learning. USA, Massachusetts: MIT Press. ISBN 9780262018258.

- ↑ Sewell, Martin. "Support Vector Machines: Mercer's Condition". Support Vector Machines.

- ↑ Rasmussen, C. E.; Williams, C. K. I. (2006). "Gaussian Processes for Machine Learning".

{{cite journal}}: Cite journal requires|journal=(help) - ↑ Honarkhah, M.; Caers, J. (2010). "दूरी-आधारित पैटर्न मॉडलिंग का उपयोग करके पैटर्न का स्टोकेस्टिक सिमुलेशन". Mathematical Geosciences. 42 (5): 487–517. doi:10.1007/s11004-010-9276-7. S2CID 73657847.

अग्रिम पठन

- Shawe-Taylor, J.; Cristianini, N. (2004). Kernel Methods for Pattern Analysis. Cambridge University Press.

- Liu, W.; Principe, J.; Haykin, S. (2010). Kernel Adaptive Filtering: A Comprehensive Introduction. Wiley. ISBN 9781118211212.

- Schölkopf, B.; Smola, A. J.; Bach, F. (2018). Learning with Kernels : Support Vector Machines, Regularization, Optimization, and Beyond. MIT Press. ISBN 978-0-262-53657-8.

बाहरी संबंध

- Kernel-Machines Org—community website

- onlineprediction.net Kernel Methods Article